Hoe generatieve AI het landschap van cybersecurity verandert

Generatieve artificiële intelligentie (AI) biedt steeds meer nieuwe mogelijkheden. Software kan afbeeldingen, video's, stemmen en zelfs programmacode genereren. En daar wordt ook steeds meer gebruik van gemaakt. Dit gebeurt echter niet alleen bovengronds. Criminelen ontdekken steeds vaker de mogelijkheden van generatieve AI voor cybercriminaliteit. En dat leidt tot nieuwe uitdagingen.

In januari van dit jaar maakten oplichters ruim €24 miljoen buit bij een bedrijf in Hong Kong. Het begon met een e-mail aan een medewerker van de chief financial officer van het bedrijf, met een verzoek om het geld over te maken naar een aantal onbekende rekeningen. Het ging om een transactie die koste wat het kost geheim moest blijven. De werknemer ging ervan uit dat het om een phishing mail ging, totdat hij later die dag een verzoek kreeg tot een videogesprek met de CFO. Op basis van dat gesprek ging de werknemer er van uit dat het verzoek legitiem was, en hij maakte het geld volgens de instructies over. Maar de video bleek vervalst te zijn met behulp van AI. De oplichters hadden genoeg data van de stem en het uiterlijk van de CFO om een video te genereren die overtuigend genoeg was om de werknemer gerust te stellen.

En ook in Nederland zijn criminelen volgens deze methodes actief. In oktober 2023 kreeg een medewerker van de online bank Bunq een Whatsapp bericht van de nieuwe topman van het bedrijf. Er werd gemeld dat er een overname was gedaan, en dat er snel geld moest worden overgemaakt om de deal te sluiten. De werknemer vertrouwde het niet, dus er volgde een videogesprek. De slechte kwaliteit van de video werd toegeschreven aan een slechte verbinding. In dit geval vertrouwde de werknemer de video echter niet. Hij zocht rechtstreeks contact met de topman, die bevestigde dat hij niet de persoon achter de berichten en de video was.

Verschillende manieren

Er zijn veel vormen van online oplichting waarmee bedrijven te maken kunnen hebben. Het gaat dan bijvoorbeeld om phishing, fraude met facturen en social engineering. En in alle gevallen kan generatieve AI gebruikt worden om dit beter te doen. Het is bijvoorbeeld mogelijk om een stapel facturen voor te leggen aan een generatieve AI. De software maakt vervolgens een model dat in enkele seconden duizenden facturen kan genereren, die vrijwel onmogelijk van echt te onderscheiden zijn. En het hoeft maar een keer raak te zijn. Ook phishing mails worden met behulp van generatieve AI steeds realistischer. Modellen die getraind zijn op de interne of externe communicatie van een bedrijf kunnen in rap tempo berichten genereren die de opmaak en het taalgebruik van een bedrijf zeer nauwkeurig kunnen controleren.

En ook het genereren van telefoon- en videogesprekken is zeer makkelijk. Bedrijven hebben vaak een publiek profiel, waardoor het makkelijk is om beeldmateriaal en geluidsopnames van management te vinden. Het gaat dan bijvoorbeeld om foto's op bedrijfssites, gesprekken met de media, promotionele video’s en opnames van vergaderingen die online beschikbaar zijn. Het is allemaal materiaal op basis waarvan realistische imitaties van personen gemaakt kunnen worden. Dit is waarschijnlijk ook hoe de topmannen van de eerder genoemde bedrijven geïmiteerd werden.

En daar komt nog bij dat de modellen steeds geraffineerder worden. Dat werkt aan twee kanten. De software kan niet alleen steeds meer realistische opnames produceren, maar heeft ook steeds minder materiaal nodig om een goed eindproduct aan te maken. Hierdoor wordt het steeds lastiger om telefoon- of videogesprekken die met AI gegenereerd zijn van echt te onderscheiden. Daarnaast is er ook steeds meer mogelijk met actief werkende generatieve AI, waarbij de stem en het gezicht van een crimineel tijdens een live gesprek actief omgevormd wordt.

Laagdrempelig

Dit soort generatieve AI-tools maken cybercriminaliteit ook steeds laagdrempeliger. Er wordt regelmatig melding gedaan van het oprollen van organisaties die handelen in gebruikersgegevens die zijn buitgemaakt bij eerdere inbreuken bij organisaties. Het gaat dan om allerlei inloggegevens en persoonlijke data die gebruikt kunnen worden in online criminaliteit.

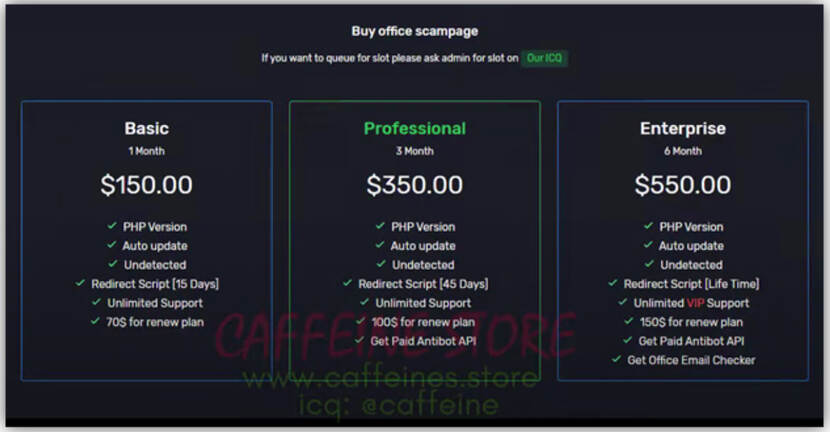

Maar er worden ook steeds meer aanbieders gevonden van complete software-pakketten om dit soort oplichting door generatieve AI mogelijk te maken. Vorige week meldde Microsoft dat het een Egyptische organisatie had opgerold die een soort doe-het-zelf pakketten verkocht voor het aanmaken van phishing mails. Het was een bijzonder professionele operatie. Er waren zelfs verschillende pakketten, met verschillende vormen van dienstverlening en ondersteuning. Het was eigenlijk niet te onderscheiden van de verkooppagina's van aanbieders van legitieme software.

Met zo'n pakket heeft een potentiële crimineel alles dat nodig is om duizenden phishing mails te genereren, zonder dat hiervoor enige technische kennis nodig is. Daarnaast kan het pakket ook websites aanmaken die niet van echt te onderscheiden zijn, waarnaar de phishing mails verwijzen. Hierdoor heeft de crimineel dus alles wat nodig is om aan de slag te gaan. De handel in tools voor cybercriminaliteit en gerelateerde diensten bestaat al decennia. Met generatieve AI wordt het echter steeds makkelijker. Meer en meer cybersecurity-bedrijven maken melding van phishing-as-a-service en ransomware-as-a-service (PaaS en RaaS).

Daarnaast kunnen diensten als ChatGPT ook programmeercode genereren. En hoewel aanbieders van dit soort diensten proberen om de mogelijkheid om hun software voor malafide doeleinden te gebruiken zo klein mogelijk te maken, kan generatieve AI niet altijd goed inschatten of het product dat gemaakt wordt de regels overtreed. Daardoor is het ook voor leken steeds makkelijker om malware aan te maken. Daarnaast kan generatieve AI ook snel verschillende varianten van een bestaand malware-programma maken. Dat maakt het lastiger dan ooit voor traditionele detectiemethoden om malware te onderscheppen.

Blijf opletten

Generatieve AI maakt cybercriminaliteit geraffineerder, maar het maakt nog steeds gebruik van dezelfde methoden om binnen te komen bij systemen. Phishing, dubieuze e-mails en social engineering blijven de voornaamste manieren waarop criminelen toegang krijgen tot netwerken en fraudulente transacties uitlokken. De gereedschappen worden steeds geraffineerder, maar het einddoel blijft hetzelfde.

De Nederlandse overheid ondersteunt burgers en bedrijven bij het veilig blijven op het internet. In oktober van dit jaar publiceerde de Algemene Inlichtingen- en Veiligheidsdienst (AIVD) het rapport Generatieve AI. Een transformatieve impact op cybersecurity. Hierin wordt uiteengezet hoe generatieve AI het landschap omtrent cybersecurity in snel tempo verandert, en welk handelingsperspectief de AIVD ziet om malafide actoren die generatieve AI gebruiken aan te pakken.

Generatieve AI geeft kwaadwillenden nieuwe manieren om bestaande methodes van cybercriminaliteit uit te voeren. Het is daarom belangrijker dan ooit om up to date te blijven. Voor bedrijven is het Digital Trust Center (DTC) het belangrijkste aanspreekpunt voor cyberveiligheid. Op de website van het DTC vindt u algemene tools, zoals de CyberVeilig Check, die gebruikt kan worden om kwetsbaarheden binnen uw organisatie in kaart te brengen. Ook zijn er informatiepagina's over bijvoorbeeld spookfacturen en social engineering. Daarnaast is er de DTC Community voor contact met experts en mede-ondernemers en het laatste nieuws op het gebied van cybersecurity.